在数据分析和建模的过程中,有相当多的时间要用在数据准备上:加载、清理、转换以及重塑。这些工作会占到分析师时间的80%或更多。幸运的是pandas和内置的Python标准库提供了高效、灵活的工具可以帮助我们轻松的做这些事情。

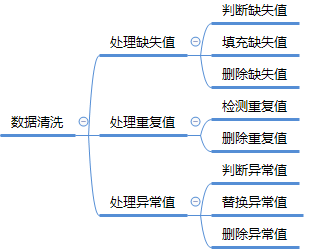

本文重点介绍通过pandas进行数据的清洗。数据处理中的清洗工作主要包括对需要分析的数据集中的缺失值(空值)、重复值、异常值的处理。对于数据清洗一般也是分两个步骤,第一步就是要很方便快速的找到需要处理的数据,如何快速找到数据中的缺失值(空值)、重复数据或异常的数据,第二步是对找到的数据根据自己的实际使用需求进行处理,如删除还是替换成其他的数据。

一、处理缺失值

在许多数据分析工作过程中,由于对数据质量问题,缺失数据是经常发生的。对于数值数据,pandas使用浮点值NaN(Not a Number)表示缺失数据。在pandas中,还采用了R语言中惯用的缺失值表示法NA,它表示不可用not available。在统计应用中,NA数据可能是不存在的数据或虽然存在但是看不到。进行数据清洗对缺失数据进行分析,以判断数据采集的问题或缺失数据导致的偏差。

1、判断缺失值(空值)

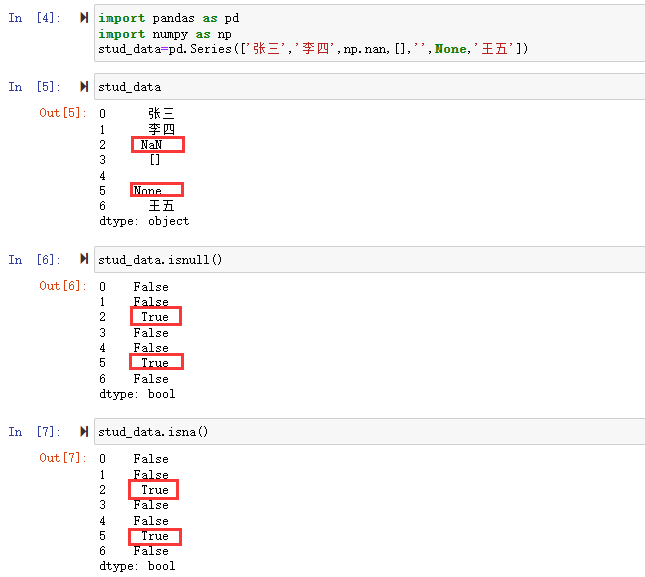

在pandas中通过isna()或isnull()方法判断空值,二者等价,用于判断一个series或dataframe各元素值是否为空的bool结果。需注意对空值的界定:即None或numpy.nan才算空值,而空字符串、空列表等则不属于空值;类似地,notna()和notnull()则用于判断是否非空。 看下实例:

import pandas as pd

import numpy as np

stud_data=pd.Series(['张三','李四',np.nan,[],'',None,'王五'])

stud_data

通过stud_data.isnull()和stud_data.isna()分别来判断空值

类似地,notna()和notnull()则用于判断是否非空

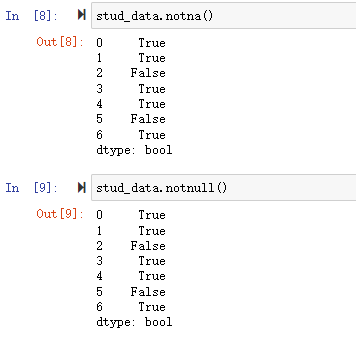

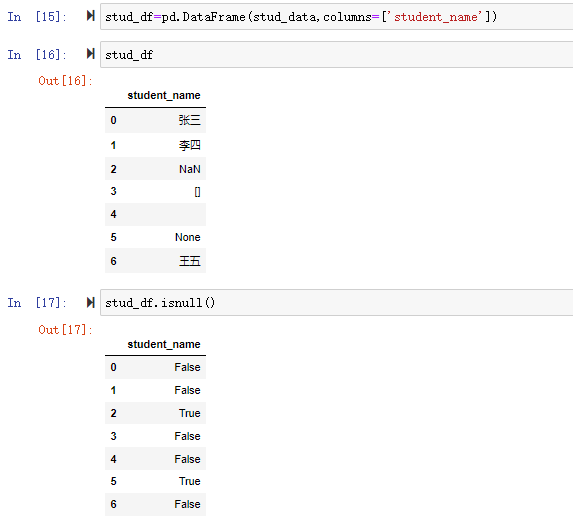

同样的对于DataFrame中的缺失数据判断也是一样的。

构建DataFrame

同样的对于DataFrame中的缺失数据判断也是一样的。

构建DataFrame

stud_df=pd.DataFrame(stud_data,columns=['student_name'])

stud_df

对于缺失值的处理有两种常用的方式,一是用按一定的策略对空值进行填充,二是对于缺失值干脆进行删除。

2、填充缺失值(空值)

pandas中用户填充缺失值的方法是fillna(),可以按一定的策略对空值进行填充,如常数填充、向前/向后填充等,也可通过inplace参数确定是否本地更改。

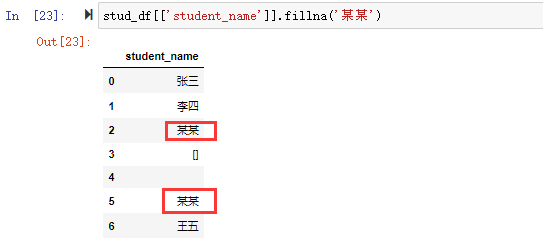

1.常量填充

stud_df[['student_name']].fillna('某某')

可以看到判断为缺失值的地方都填充了"某某",因为空字符串和空列表都不是缺失值,所以没有填充。

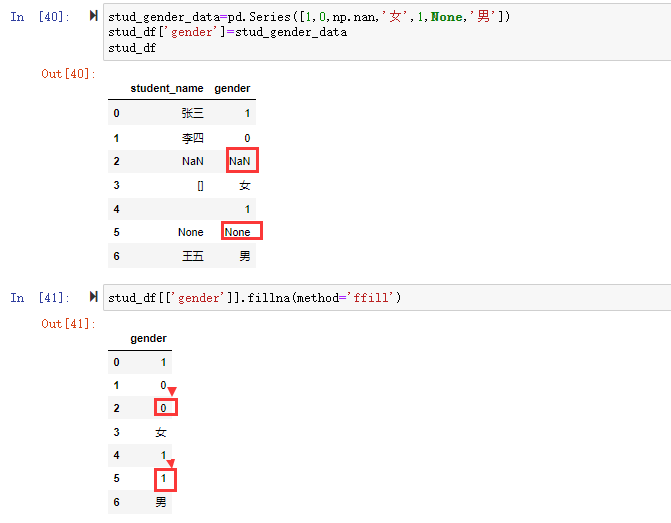

2.向前和向后填充NA

通过fillna(mathod='ffill'),mathod='ffill' 向前填充和 mathod='bfill' 向后填充,也就是说用前面的值来填充NA或用后面的值来填充NA 我们来增加一列性别列gender来看一下。

stud_gender_data=pd.Series([1,0,np.nan,'女',1,None,'男'])

stud_df['gender']=stud_gender_data

stud_df

stud_df[['gender']].fillna(method='ffill')

可以看到通过method='ffill',将NaN和None前面的值填充端到了NaN和None。

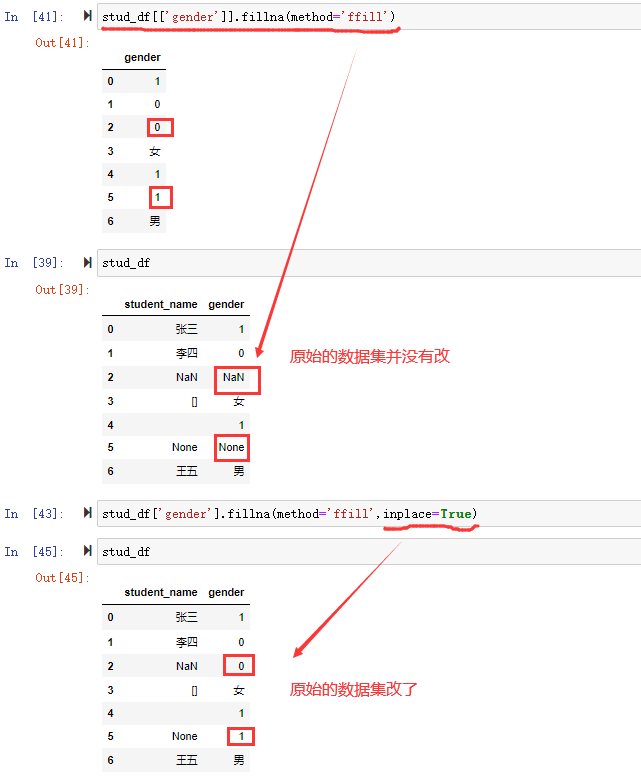

用fillna()进行填充会返回一个填充好的数据集的副本,并没有对原始数据进行操作,如果要修改原始数据可以通过inplace参数确定是否本地更改。

3、删除缺失值(空值)

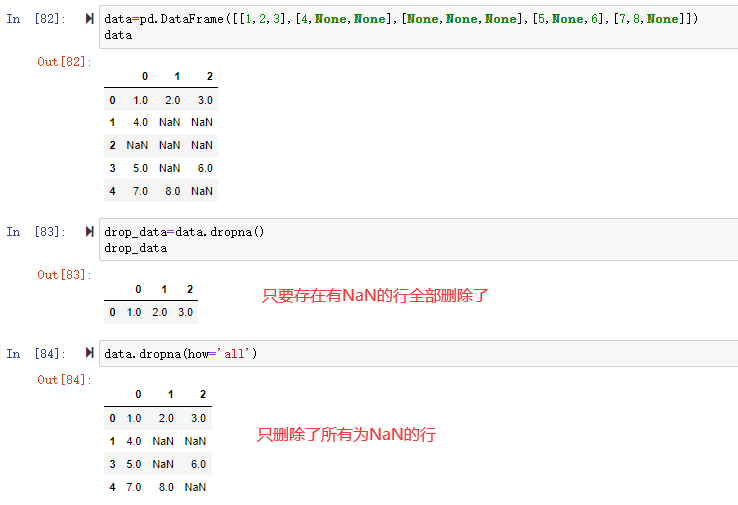

如果想删除缺失值,那么使用 dropna() 函数与参数 axis 可以实现。在默认情况下,按照 axis=0 来按行处理,这意味着如果某一行中存在 NaN 值将会删除整行数据。如果在dropna()中传入how='all'将只会删除全为NA或NaN的行。示例如下:

二、处理重复值

重复数据也是在实际数据处理过程中碰到比较多的,处理重复数据就是在数据集中找出重复数据然后将其删除保留一个唯一不重复的数据。

1、检测重复值

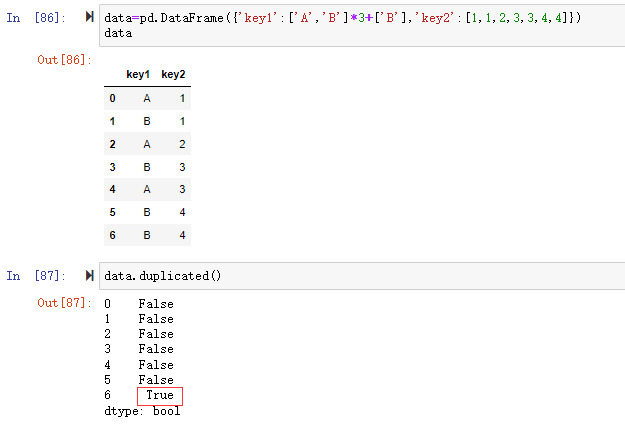

pandas通过duplicated()方法检测各行是否重复,返回一个行索引的bool结果,可通过keep参数设置保留第一行、最后一行、无保留,例如keep=first意味着在存在重复的多行时,首行被认为是合法的而可以保留。 构造一个DataFrame来看一个实例:

data=pd.DataFrame({'key1':['A','B']*3+['B'],'key2':[1,1,2,3,3,4,4]})

data

data.duplicated()

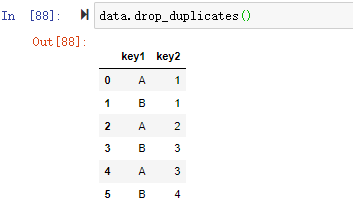

2、删除重复值

pandas通过drop_duplicates()方法按行检测并删除重复的记录,也可通过keep参数设置保留项。由于该方法默认是按行进行检测,如果存在某个需要需要按列删除,则可以先转置再执行该方法。

data.drop_duplicates()

可以看到第7行也就是index为6的重复行被删除了。

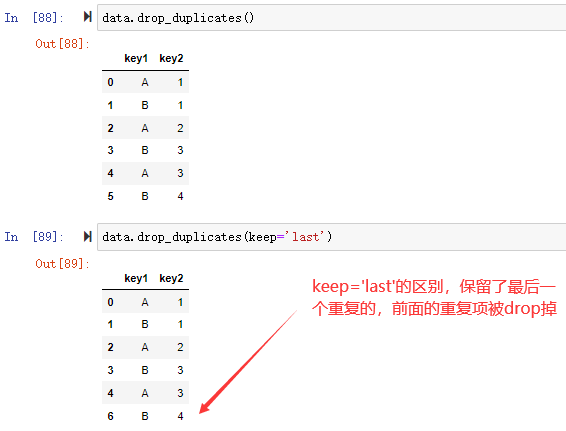

当带了

可以看到第7行也就是index为6的重复行被删除了。

当带了keep='last'参数时,保留最后一个重复项,前面的重复项将被丢弃。可以看到保留的是索引为6的,索引为5的重复项被丢弃了。

三、处理异常值

1、判断异常值

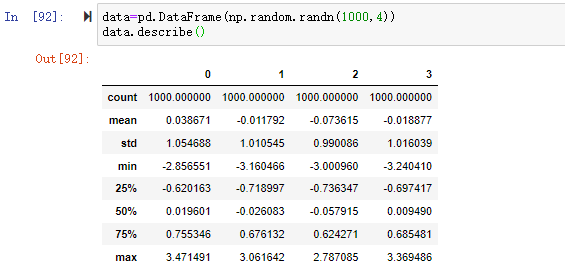

判断异常值的标准依赖具体分析数据,如大于或小于某个基线范围的值。 我们来看一个含有正态分布的DataFrame数据集

data=pd.DataFrame(np.random.randn(1000,4))

data.describe()

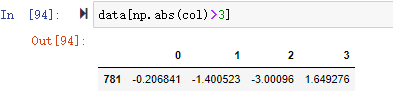

假设我们认为某列中绝对值大小超过3的是异常值,那么判断异常值就是要找出某列中大小超过3的值。

data[np.abs(col)>3]

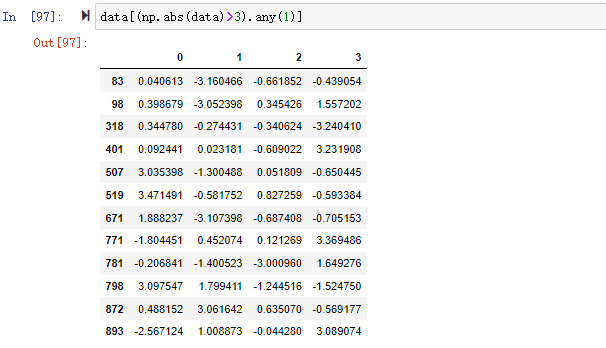

要选出全部含有绝对值大小超过3的行,可以在布尔型DataFrame中使用any()方法。

data[(np.abs(data)>3).any(1)]

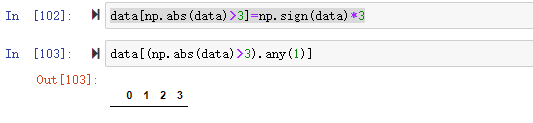

2、替换异常值

对于异常值,可以直接替换。 如:

data[np.abs(data)>3]=np.sign(data)*3

这样就可以将异常值替换为绝对值不大于3的

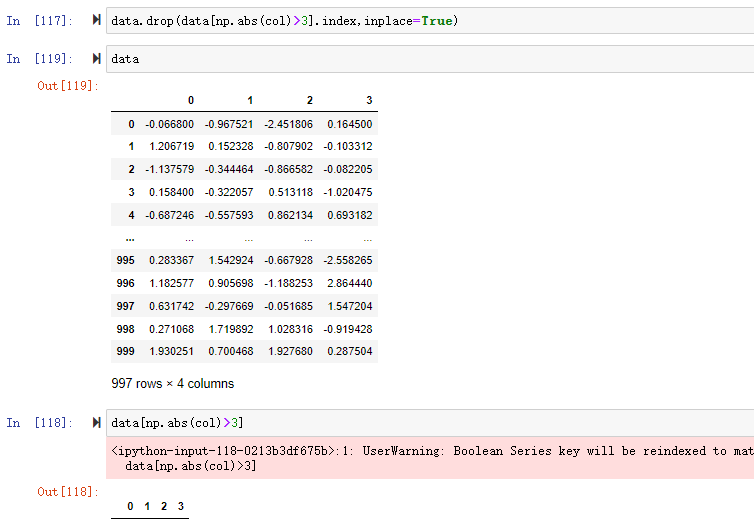

3、删除异常值

删除异常值,可以用pandas的drop()方法,接受参数在特定轴线执行删除一条或多条记录,可通过axis参数设置是按行删除还是按列删除 如删除第3列,列索引为2的列中绝对值>3的行

col=data[2]

data.drop(data[np.abs(col)>3].index,inplace=True)

可以看到本来有1000行的,删除了3行,再用data[np.abs(col)>3]验证,已经找不到数据了。

至此,本文通过实例介绍了pandas进行数据清洗包括缺失值、重复值及异常值的处理。数据清洗是数据分析前面的准备工作,数据质量的好坏将直接影响数据分析的结果。

作者博客:http://xiejava.ishareread.com/

关注:微信公众号,一起学习成长!